クロールバジェットとは、Googleがあなたのサイトをクロール(巡回)する量の上限のことです。

「新しいページがなかなかインデックスされない」「更新したのに検索結果に反映されない」という問題を抱えているなら、クロールバジェットが原因かもしれません。

ただし、先にお伝えしておくと、数千ページ以下の小〜中規模サイトではクロールバジェットを気にする必要はほとんどありません。Google公式もこの点を明言しています。

本記事では、クロールバジェットの仕組みから、自分のサイトが対策すべきかの判断基準、具体的な最適化方法、Googleのクロール頻度の確認方法まで解説します。

\ インデックス状態を自動で監視 /

クロールバジェットとは?定義と仕組み

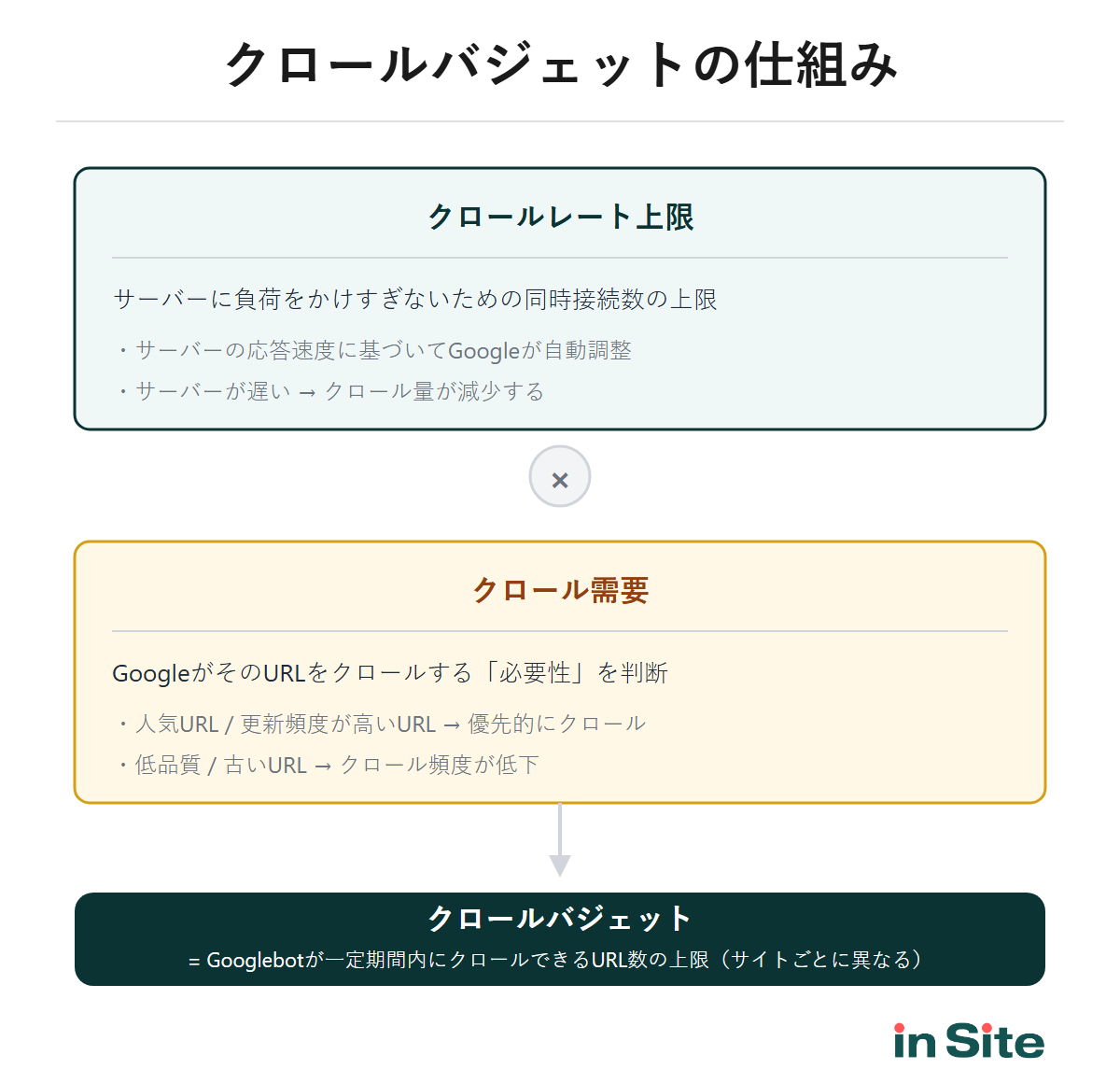

クロールバジェットは「クロールレート上限」と「クロール需要」の2つの要素で決まります。

Googlebotは世界中の膨大なWebページを巡回しています。しかし、1つのサイトに対して無制限にクロールするわけではありません。サーバーに過度な負荷をかけないように、そしてGoogleのリソースを効率的に使うために、サイトごとにクロール量の上限が設けられています。

これがクロールバジェットです。

Google検索セントラルでは、クロールバジェットについて次のように説明しています。

Googlebot がサイトのクロールに費やすことのできるリソースには限りがあります。サイトにおける Googlebot のクロール アクティビティの量と頻度は、一般に「クロール バジェット」と呼ばれます。

クロールレート上限(サーバー負荷に基づく制限)

クロールレート上限とは、Googlebotがサーバーに負荷をかけすぎないように設定された同時接続数の上限です。

Googlebotはサーバーの応答速度を常にモニタリングしています。応答が速ければクロール量を増やし、遅ければ自動的にクロール量を減らす仕組みです。

つまり、サーバーが遅いサイトはクロールバジェットが小さくなるということ。サーバーのパフォーマンス改善は、クロールバジェット最適化の基本中の基本です。

クロール需要(Googleが判断するクロールの必要性)

クロール需要とは、「そのURLをクロールする価値がどれだけあるか」をGoogleが判断した結果です。

- 人気のあるURL(被リンクが多い、アクセスが多い)

- 更新頻度が高いURL

- 新しく発見されたURL

- サイトマップに含まれているURL

逆に、低品質なページや長期間更新されていないページは、クロール頻度が徐々に下がっていきます。

Googleがどのようにインデックス登録を判断しているか、全体像を把握したい方は以下の記事もあわせてご覧ください。

関連記事 インデックスカバレッジとは?全18ステータスの対処優先度と確認方法 →クロールバジェットを気にすべきサイトの判断基準

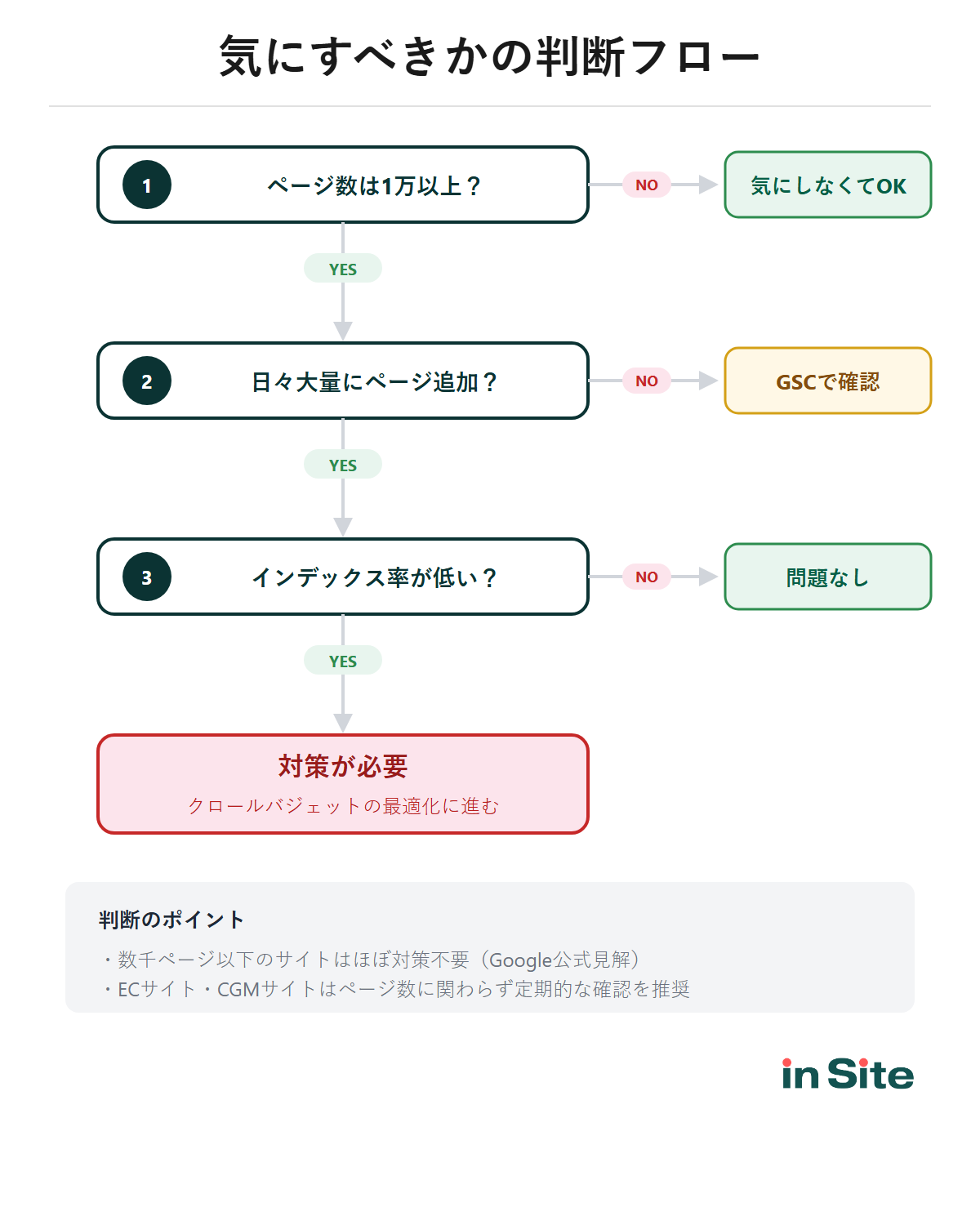

「自分のサイトはクロールバジェットを気にすべきなのか?」と不安に思う方は多いでしょう。結論から言うと、ほとんどのサイトでは対策不要です。

Google検索セントラルでも、次のように明記されています。

URL が数千に満たない小規模なサイトでは、クロール バジェットについて心配する必要はほぼありません。

気にすべきサイト

- 1万ページ以上の大規模サイト

- ECサイト(商品ページ × カラー・サイズなどのパラメータで膨大なURLが発生)

- CGM・UGCサイト(ユーザー投稿によってページが際限なく増える)

- 1日に数百〜数千ページを追加するメディアサイト

これらのサイトでは、Googlebotが全ページをクロールしきれない状況が起こりえます。新しいページや更新したページが検索結果に反映されるまで時間がかかったり、そもそもインデックスされないといった影響が出ることもあるでしょう。

気にしなくてよいサイト

数千ページ以下のコーポレートサイトやブログでは、クロールバジェットが問題になることはまずありません。

「ページがインデックスされない」という問題は、クロールバジェットではなくコンテンツの品質や重複が原因であるケースがほとんどです。

関連記事 「クロール済み - インデックス未登録」は放置OK?原因別の判断基準と対処法 →クロールバジェットに影響する要因

大規模サイトでクロールバジェットが不足する主な原因は、「価値の低いURL」がバジェットを浪費していることです。

Googlebotが巡回できる量には限りがあるため、不要なページにクロールを使ってしまうと、本来クロールすべき重要なページに手が回らなくなります。

重複コンテンツ・パラメータURL

クロールバジェットを最も浪費しやすいのが重複コンテンツです。

- wwwあり / なしの両方にアクセスできる

- http / https の両方が存在する

- URLパラメータ付きの重複(ソート順、フィルタ条件など)

- ECサイトのカラー・サイズ違い商品ページ

- 末尾スラッシュの有無(/blog と /blog/)

1つのコンテンツが複数のURLで存在すると、Googlebotは同じ内容を何度もクロールすることになります。

関連記事 重複コンテンツとは?SEOへの影響と対策方法をわかりやすく解説 →ソフト404エラー

ソフト404とは、実際には存在しないページなのに、ステータスコード200(正常)を返してしまうケースです。

Googlebotはこのようなページもクロール対象として扱うため、バジェットの無駄遣いにつながります。

関連記事 ソフト404エラーとは?原因・確認方法・対処法をわかりやすく解説 →リダイレクトチェーン

リダイレクトが何段階も連鎖していると、Googlebotは途中で追跡を停止する場合があります。

Googlebotはリダイレクトを最大5回まで追跡しますが、それを超えるとクロールを中断します。リダイレクトチェーンが長いほどバジェットの浪費も大きくなるため、直接リダイレクトに修正しましょう。

関連記事 リダイレクトチェーンとは?SEOへの影響と確認・解消方法を徹底解説 →低品質コンテンツ・スパム

ハッキングされたページや自動生成された低品質なページも、クロールバジェットを浪費します。

Googleはこれらのページを「価値の低いURL」として分類しており、サイト全体のクロール効率を下げる原因になります。定期的にサイト内のコンテンツを監査し、不要なページは削除またはnoindex設定しておきましょう。

無限スペース

カレンダーの「翌月」リンクを無限にたどれるページや、フィルタの組み合わせで無限にURLが生成されるケースは、Googlebotがクロールし続けてバジェットを浪費する典型的なパターンです。

- カレンダーの「前月」「翌月」リンクが無限に続くページ

- ECサイトのフィルタ条件の組み合わせ(カラー × サイズ × 価格帯 × ...)

- セッションIDやトラッキングパラメータ付きURL

クロールバジェットを最適化する6つの方法

ここからは、クロールバジェットを最適化するための具体的な方法を紹介します。上から順に効果が大きいものを並べています。

1. robots.txtで不要ページのクロールをブロックする

最もシンプルで効果的な方法です。インデックスさせる必要のないページを、robots.txtでGooglebotのクロール対象から除外しましょう。

- 管理画面(/admin/、/wp-admin/)

- 検索結果ページ(/search?q=...)

- フィルタ結果ページ(/products?color=...&size=...)

- テスト環境・ステージング環境

- カートページ・マイページ

2. 重複コンテンツをcanonicalやリダイレクトで統合する

同じ内容のページが複数のURLで存在する場合は、canonicalタグで正規URLを指定するか、301リダイレクトで1つのURLに統合しましょう。

ECサイトでよくある「パラメータ違いの重複ページ」は、canonicalタグでの正規化が最も現実的な対応方法です。

関連記事 canonicalタグとは?書き方・設定が必要なケース・確認方法をわかりやすく解説 →3. XMLサイトマップを最新の状態に保つ

XMLサイトマップは、Googlebotに「クロールしてほしいURL」を伝える手段です。サイトマップにはインデックスさせたいURLだけを含め、不要なURL(リダイレクト先、削除済みページなど)は除外しておきましょう。

存在しないURLをサイトマップに残したままにしていると、Googlebotが無駄なクロールを繰り返す原因になります。

lastmod(最終更新日時)も正確に設定しておくと、Googlebotが更新されたページを優先的にクロールしてくれます。

関連記事 XMLサイトマップとは?SEO効果・作り方・送信方法を実務者向けに解説 →4. 削除済みページに404/410を正しく返す

削除したページには、適切なHTTPステータスコードを返すことが大切です。

404は「ページが見つからない」、410は「ページが完全に削除された」ことを意味します。どちらもGooglebotに「このURLはもうクロールしなくてよい」と伝える効果がありますが、410のほうが「永久に削除された」というシグナルが強く、Googlebotがより早くクロール対象から外す傾向があります。

5. リダイレクトチェーンを解消する

A → B → C → D のようにリダイレクトが複数回続く「リダイレクトチェーン」は、A → D への直接リダイレクトに修正しましょう。

チェーンの段数が増えるほどGooglebotのクロール効率が下がり、バジェットの無駄遣いにつながります。

6. ページの読み込み速度を改善する

サーバーの応答速度は、クロールレート上限に直接影響します。応答が遅いサーバーほど、Googlebotは1回のクロールセッションで取得できるURL数を減らすためです。

サーバー応答時間(TTFB)の改善、画像の最適化、キャッシュの適切な設定など、サイト全体のパフォーマンス改善がクロールバジェットの向上にもつながります。

関連記事 ページスピードとは?SEO・CVRへの影響と改善の優先順位を実務者向けに解説 →Googleのクロール頻度を確認する方法

クロールバジェットの最適化を行ったら、その効果を確認しましょう。ここでは、Googleのクロール頻度を確認する4つの方法を紹介します。

サーチコンソールの「クロールの統計情報」の見方

Googleサーチコンソールの「クロールの統計情報」では、Googlebotのクロール状況をグラフで確認できます。

確認手順は以下の通りです。

特に注目すべき指標は以下の2つです。

- クロールリクエストの合計数 ─ Googlebotが1日にクロールしたURL数。この数値が極端に少ない場合、クロールバジェットに問題がある可能性がある

- 平均応答時間 ─ サーバーの応答速度。この数値が増加傾向にある場合、クロールレート上限が引き下げられている可能性がある

平均応答時間が増加傾向にある場合は、サーバーのパフォーマンスに問題が発生しているサインです。ホスティング会社やインフラチームに相談しましょう。

URL検査ツールで個別ページのクロール日時を確認する

特定のページがいつクロールされたか確認したい場合は、サーチコンソールのURL検査ツールが便利です。

対象のURLを入力すると、「最終クロール日時」が表示されます。重要なページのクロール日が古い場合は、サイトマップへの追加や内部リンクの見直しを検討しましょう。

関連記事 URL Inspection API×GASでインデックス状況を自動一括チェックするスプレッドシート →サーバーログでGooglebotのアクセスを分析する

より詳細な分析をしたい場合は、サーバーのアクセスログを直接確認する方法もあります。

access.logからGooglebotのリクエストだけを抽出することで、「どのURLが何回クロールされたか」「クロール頻度の推移」などを細かく分析できます。ただし、ログの解析にはある程度の技術知識が必要なため、上級者向けの方法です。

inSiteでクロール状態を継続的にモニタリングする

サーチコンソールのURL検査ツールでは、1つずつURLを入力して確認する必要があり、ページ数が多いサイトでは現実的ではありません。

サイト管理ツールinSite(インサイト)なら、全ページのクロール日を自動で取得し、一覧で確認できます。

「いつクロールされたか」「クロール頻度が落ちていないか」を一目で把握でき、クロールバジェットの問題に早期に気づけます。クロール日が古いまま放置されているページを発見した場合は、内部リンクの追加やコンテンツの更新で対応しましょう。

よくある質問

まとめ

クロールバジェットの仕組みと最適化方法を解説しました。

- クロールバジェットはGoogleがサイトをクロールする量の上限

- 数千ページ以下の小〜中規模サイトは基本的に気にしなくてよい

- 重複コンテンツやソフト404がバジェットを浪費する主な原因

- robots.txt・サイトマップ・重複統合で最適化できる

- GSCの「クロールの統計情報」でクロール頻度を確認できる

まずはサーチコンソールの「クロールの統計情報」を確認して、自分のサイトの現状を把握してみてください。クロールリクエスト数や応答時間に異常がなければ、クロールバジェットについて心配する必要はほとんどありません。

大規模サイトでクロールバジェットの最適化に取り組む場合は、robots.txtの設定や重複コンテンツの統合から始めるのが効率的です。

\ クロール状態を自動で監視 /