サーチコンソールの「クロールの統計情報」は、Googlebotが過去90日間にサイトをどう巡回したかを確認できる唯一のレポートです。インデックス問題やサーバー負荷、クロールバジェットの診断に使えます。

サーチコンソールの設定メニューを開くと「クロールの統計情報」という項目があります。開いてみると3つのグラフと複数の詳細レポートが並んでいて、「この数字をどう読めばいいのか」「正常なのか異常なのか」と戸惑う方は多いはずです。

このレポートはGoogle公式も「上級ユーザー向け」と明記しているとおり、情報密度が高くハードルのあるレポート。ただし、4つの主要指標と詳細レポートの読み方を押さえれば、技術的なSEO問題を早期に発見できる強力な武器になります。

この記事では、クロールの統計情報の開き方、4指標の見方、異常値の診断と対処法、そして実務で活かすチェックリストまでまとめて解説します。

\ クロール頻度の変化を、 URLごとに毎日自動取得 /

inSiteのインデックス状況自動チェック機能

inSiteは全ページのインデックス状態を URL Inspection API で毎日自動取得し、 lastCrawlTime と crawledAs (MOBILE/DESKTOP) を蓄積します。GSC本体のクロール統計ではサイト全体しか見えませんが、 inSiteならURLごとにクロール頻度をモニタリングできます。

lastCrawlTime・crawledAs を全URLで毎日蓄積

インデックス状況自動チェック機能の詳細を見る ↗inSiteのインデックス状況自動チェック機能を無料で試してみる

サーチコンソールの「クロールの統計情報」とは

クロールの統計情報は、サーチコンソールの中でも技術的SEOに特化したレポートです。まずは役割と「誰が使うべきか」を押さえましょう。

クロールの統計情報で分かること

クロールの統計情報レポートは、Googlebotがサイトに対して行った巡回行動の数値を可視化するレポートです。過去90日間のクロール回数、データ量、応答時間、HTTPステータスコード別の内訳などを確認できます。

このレポートで分かることは主に3つあります。

- Googlebotがどれだけサイトに来ているか

過去90日間のクロール回数とその推移が分かる - サイトの技術的健全性

サーバー応答時間、robots.txt取得の可否、エラー発生状況が把握できる - クロールの質と効率

どんなファイル(HTML・画像・JS)が多くクロールされているか、発見クロールと更新クロールのバランスが見える

検索パフォーマンスレポートが「流入結果」を見るのに対し、クロールの統計情報は「流入の前段階であるクロール行動そのもの」を見る点で役割が異なります。クローラーの仕組み自体を理解したい場合は以下の記事も参考にしてください。

関連記事 クローラーとは?仕組みとSEOでの最適化方法 →どんな人が見るべきか

クロールの統計情報はGoogleの公式ヘルプでも「上級ユーザー向け」と明記されています。規模や状況によって活用度が変わるため、見るべき人の目安を整理しておきます。

- 数千ページ以上の中〜大規模サイトを運営している

- インデックスされないページが増えてきた

- サイトリニューアルや大量のコンテンツ追加を行った直後

- サーバー負荷やページ速度の問題を感じている

- クロールバジェットの最適化に取り組みたい

小規模サイト(数百ページ以下)では日々の変化が見えにくく、クロール状況を細かくチェックする必要性は低めです。ただし、インデックス漏れなどの異常を抱えているときは規模に関係なく役立ちます。

サーチコンソールで「クロールの統計情報」を開く手順

クロールの統計情報は、サーチコンソールの左メニューの奥にあるため、見つけにくいレポートです。開き方を押さえておきましょう。

設定メニューからレポートを開く

サーチコンソールにログインして、以下の順にクリックすればたどり着けます。

- サーチコンソールの左メニュー最下部にある「設定」をクリック

- 「クロール」の見出しの下にある「クロールの統計情報」を探す

- 「レポートを開く」ボタンをクリック

- ドメインプロパティでのみ利用可能

URLプレフィックスプロパティでは「クロールの統計情報」自体が表示されない。ドメインプロパティを登録し直す必要がある - データが表示されるまで数日かかる

新規プロパティでは数日〜1週間程度のデータ蓄積が必要

レポートの基本構造

レポートを開くと、画面は大きく3つのブロックに分かれています。

- 上部: 主要グラフ3つ

クロールリクエスト数、ダウンロード合計サイズ、平均応答時間の90日推移 - 中部: ホストのステータス

robots.txt・DNS・サーバー接続の健全性(緑/黄/赤の3段階) - 下部: 詳細レポート4種類

レスポンス別・ファイル形式別・クロール目的別・Googlebot種類別

まずは上部のグラフで全体のトレンドを掴み、異常があれば下部の詳細レポートで原因を掘り下げる、という順番が基本の見方です。

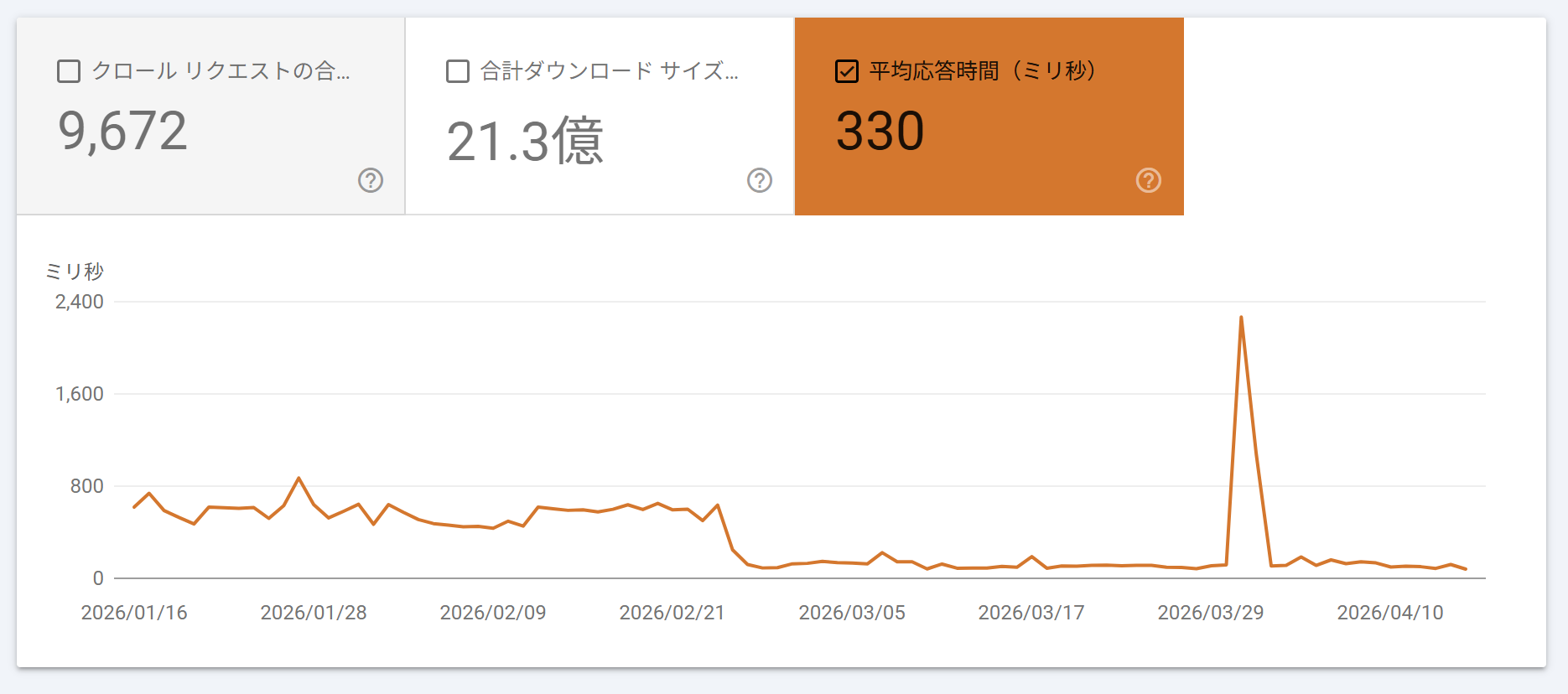

クロールの統計情報で見る4つの主要指標

レポートを開いたら、まず確認すべき4つの指標があります。それぞれの定義と見るポイントを整理します。

クロールリクエストの合計数

クロールリクエストの合計数は、過去90日間でGooglebotがサイトに送ったリクエストの総数です。このグラフで「サイトがどれだけ巡回されているか」の全体トレンドを掴みます。

- 緩やかな増減は正常

数%〜数十%の日々の変動は通常の範囲 - 急増パターン

新規ページの大量追加、URLパラメータの増加、サイトマップ更新後の発見クロール増 - 急減パターン

robots.txtの誤設定、サーバー障害、noindexの大量設置、サイトマップから削除

特に急減は放置すると新規ページのインデックスが遅れるため、早急な原因特定が必要です。

ダウンロードの合計サイズ

ダウンロードの合計サイズは、Googlebotがサイトからダウンロードしたデータの総量です。単位はKBまたはMBで表示されます。

この数値が大きすぎる場合、クロール効率が悪い可能性があります。具体的には、画像やJavaScriptファイルが重い、不要なリソースまでクロールされている、などのケースです。

クロール数が変わっていないのにダウンロードサイズだけ急増している場合は、サイト内のファイル容量に変化がなかったか、新しいリソースが追加されていないかを確認しましょう。

平均レスポンス時間

平均レスポンス時間は、Googlebotのリクエストに対してサーバーが応答するまでの平均時間です。技術的SEOにおける最も重要な指標のひとつです。

- 100〜500ミリ秒

理想的な範囲。クロール効率が良い - 500〜1,000ミリ秒

改善の余地あり。サーバーやページ速度の見直しを検討 - 1,000ミリ秒(1秒)超

明確に改善が必要。クロールバジェットを圧迫しインデックスにも悪影響

応答時間が悪化した場合、サーバースペック不足、画像最適化不足、データベースクエリの遅延などが主な原因です。ページ速度全般の改善方法は以下の記事で解説しています。

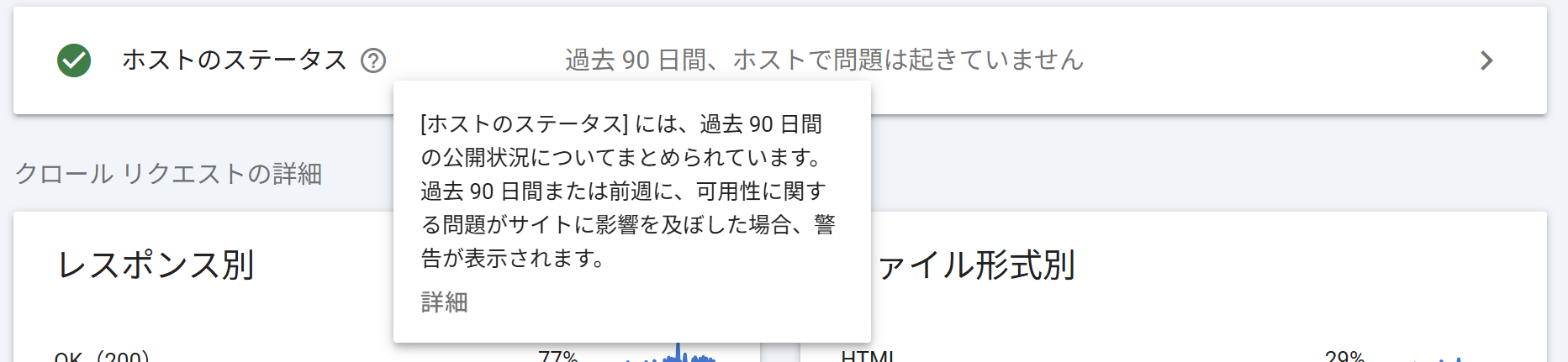

関連記事 ページスピードとは?SEOへの影響と改善方法を徹底解説 →ホストのステータス

ホストのステータスは、サイトがGooglebotから正常にアクセスできる状態かを判定する指標です。グラフの下に緑・黄・赤の3段階で表示されます。

判定基準は3つあります。

- robots.txtの取得

Googlebotがrobots.txtを正常に取得できているか - DNSの解決

ドメインがIPアドレスに正しく名前解決されているか - サーバー接続

Googlebotがサーバーに問題なく接続できているか

赤や黄色の場合は緊急性の高い問題です。サーバーやDNSの設定、robots.txtの配置状況を確認してください。緑であれば基本的に問題ありません。

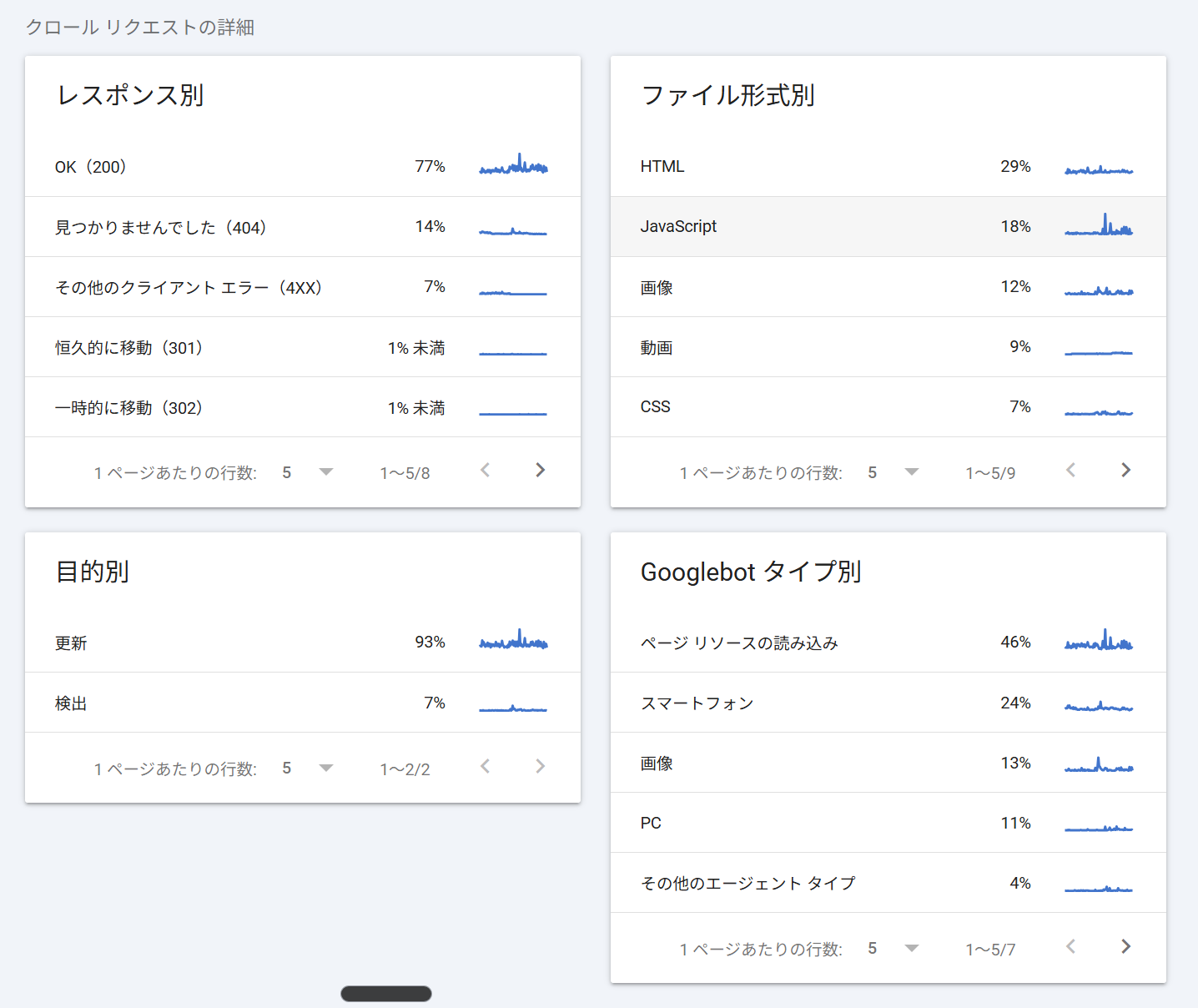

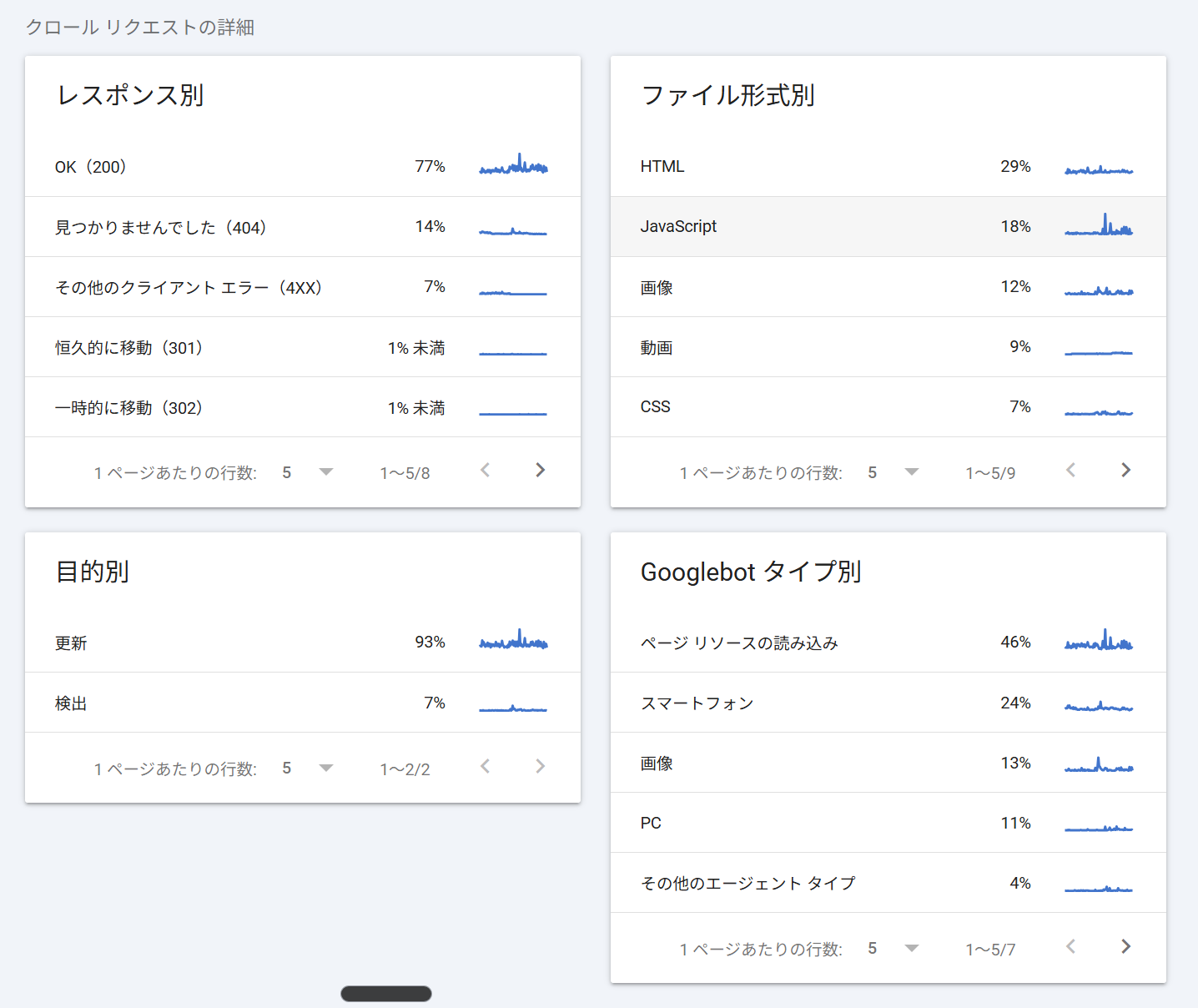

クロールの統計情報の詳細レポートの読み方

画面下部には4種類の詳細レポートが並んでいます。それぞれクロールの「内訳」を見られるレポートで、異常の原因特定に使います。

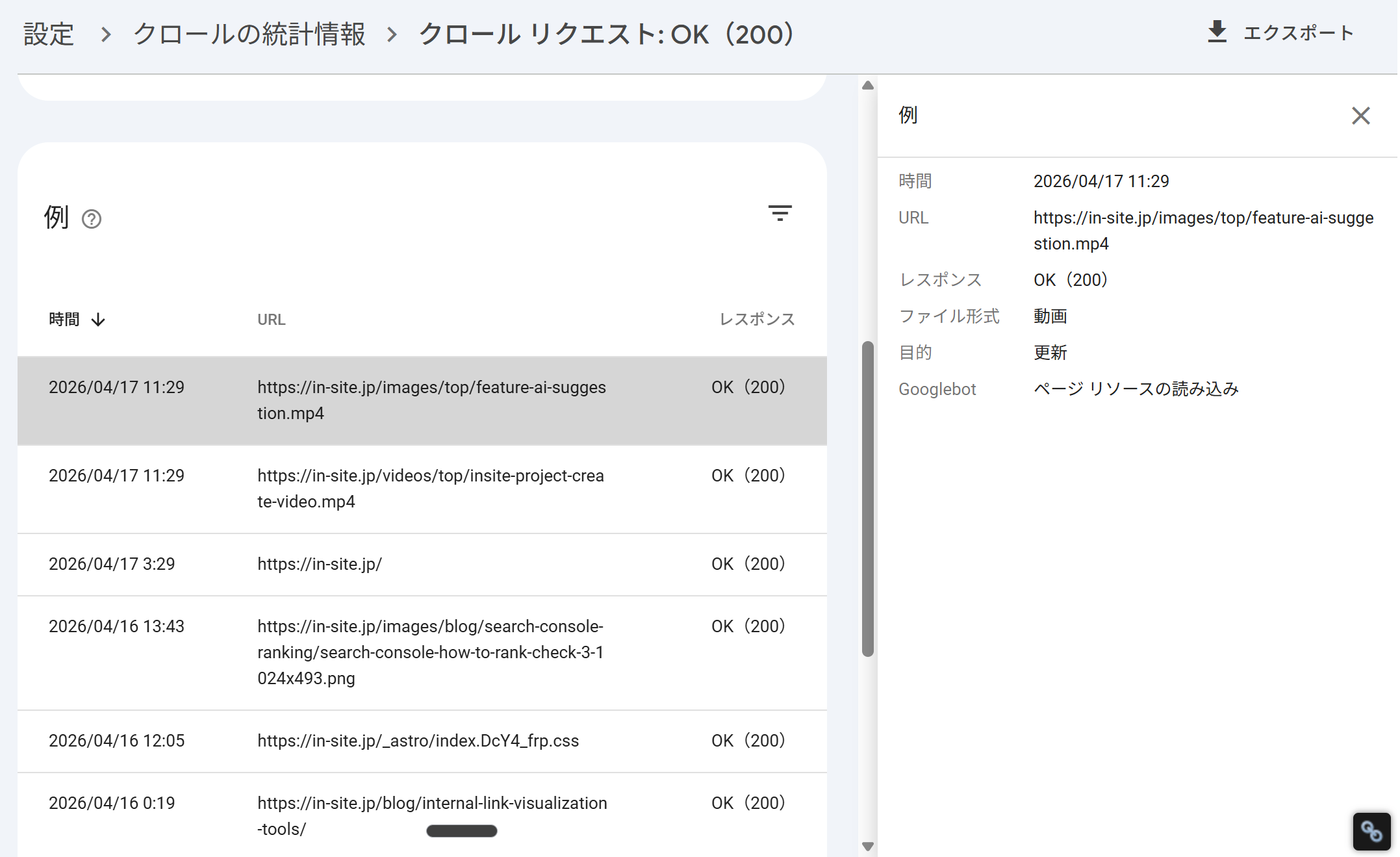

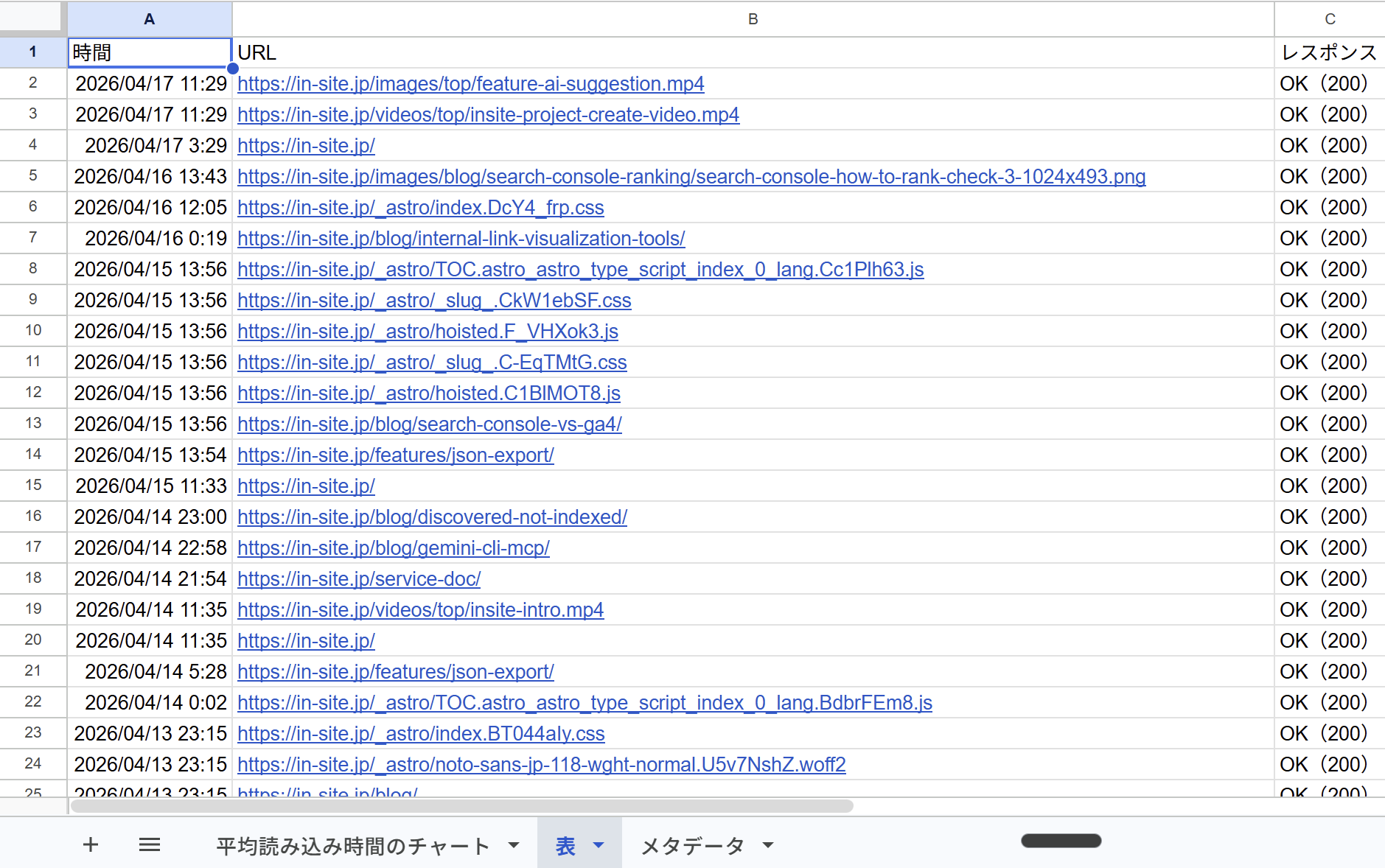

4つのカードはどれも、気になる行をクリックするとその条件に絞り込んだ詳細画面に遷移できます。絞り込み後の画面では、該当するクロールリクエストの日別推移グラフと、実際にクロールされたURLの一覧(時刻つき)を確認できます。

さらに一覧の中で個別のURLをクリックすると、そのクロールリクエストの時間・URL・レスポンス・ファイル形式・目的・Googlebotタイプがまとめて表示されます。

異常が見つかった場合(404多発、特定ファイル形式の急増など)、このドリルダウン機能で実際のURLと属性を特定すれば原因調査が一気に進みます。

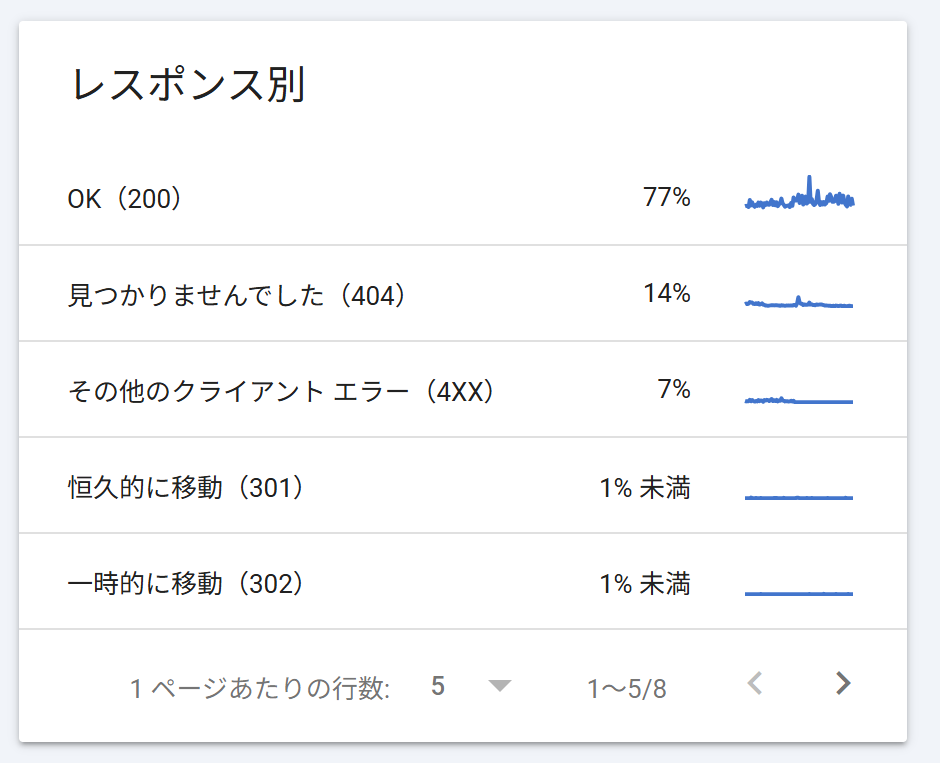

レスポンス別(HTTPステータスコード)

レスポンス別レポートは、Googlebotが受け取ったHTTPステータスコードの内訳を示します。コードごとに意味が異なるため、正常系・要確認・異常系の3分類で押さえましょう。

| 分類 | ステータスコード | 意味と対応 |

|---|---|---|

| 正常系 | 200 OK / 304 Not Modified | 問題なし。大半がこの2つであれば健全 |

| 要確認 | 301 / 302リダイレクト | 意図したリダイレクトなら問題なし。リダイレクトチェーンや意図しない302が多い場合は整理が必要 |

| 異常系 | 404 / 5xx / robots.txt拒否 | 一定以上発生している場合は対処必須。原因特定と修正が必要 |

404エラーが多発しているときは、削除済みページへのリンクが残っている可能性が高いため、以下の記事も確認しておきましょう。

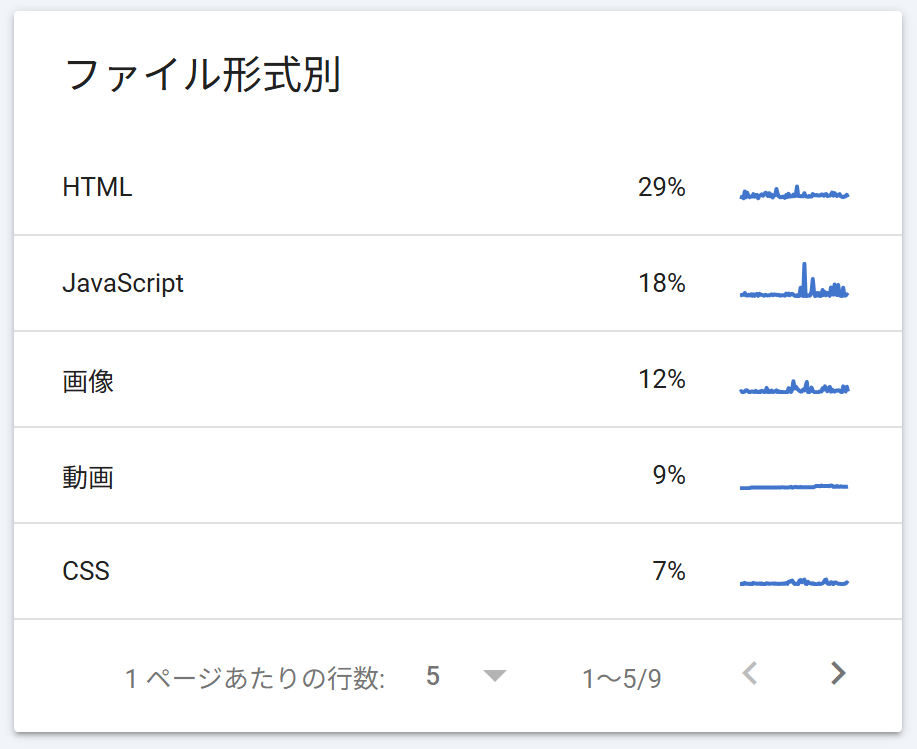

関連記事 サーチコンソール「見つかりませんでした(404)」とは?対処が必要なケースと放置してよいケースを解説 →ファイル形式別

ファイル形式別レポートは、クロールされたリソースをファイルタイプごとに分類します。HTML、画像、JavaScript、CSS、JSONなどの比率が確認できます。

- 画像やJSの比率が異常に高い

クロールの無駄遣いの可能性。robots.txtで不要リソースをブロック検討 - HTMLの比率が低すぎる

インデックスさせたいページがクロールされていない可能性 - 特定フォーマットの急増

大量のリソース追加や、URLパラメータ爆発の可能性

クロール目的別

クロール目的別レポートは、Googlebotがどのような意図でクロールしたかを「発見」と「更新」の2種類に分類します。

- 発見クロール

新規URLを見つけるためのクロール。新規ページ追加が多いサイトで比率が高い - 更新クロール

既存URLの変更を確認するためのクロール。既存記事を頻繁に更新するサイトで比率が高い

理想のバランスはサイトのフェーズによって異なります。立ち上げ期は発見クロールが多く、成熟期は更新クロールが多くなる傾向があります。発見クロールが急減した場合は、新しいページがインデックスされにくい状態を示唆します。

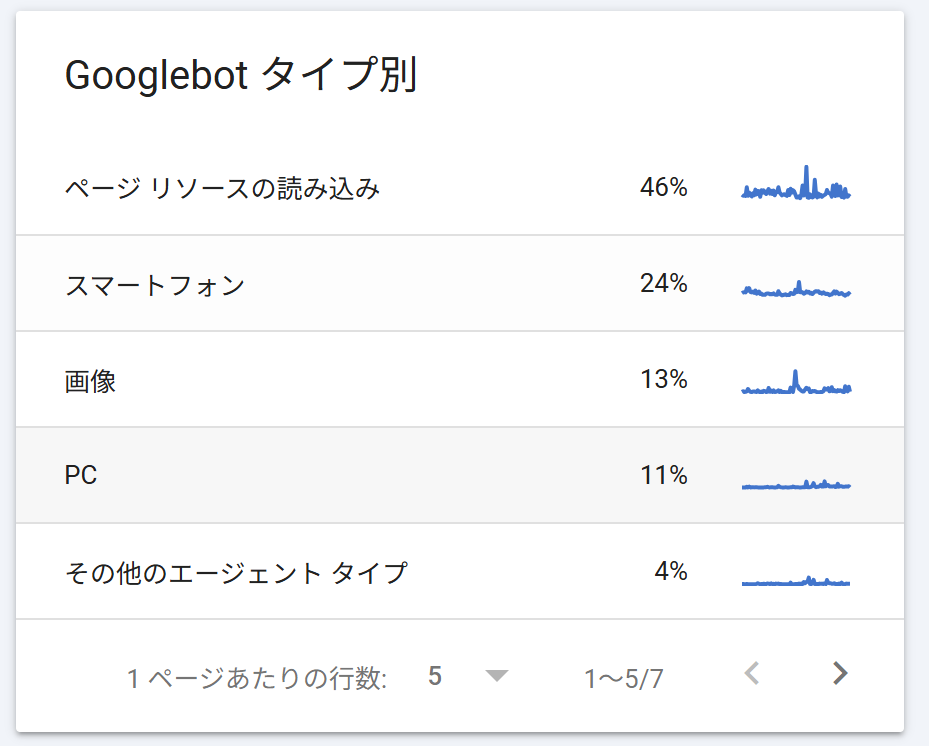

Googlebotの種類別

Googlebotの種類別レポートは、どのタイプのクローラーがアクセスしたかを分類します。モバイル、PC、画像、動画、AdsBotなど10種類以上が存在します。

MFI(モバイルファーストインデックス)移行以降、モバイル用Googlebotが大半を占めるのが通常です。モバイルの比率が極端に低い場合はモバイル対応に何らかの問題があるサインです。

なお2026年はGPTBotやClaudeBotなどのAIクローラーも増加していますが、これらはGooglebotとは別のクローラーでありこのレポートには表示されません。

スプレッドシートにエクスポートしてデータを深掘りする

クロールの統計情報は、画面右上の「エクスポート」ボタンからGoogleスプレッドシート・Excel・CSV形式で書き出せます。管理画面では見られない時系列データや個別URLを大量に扱いたい場合に便利です。

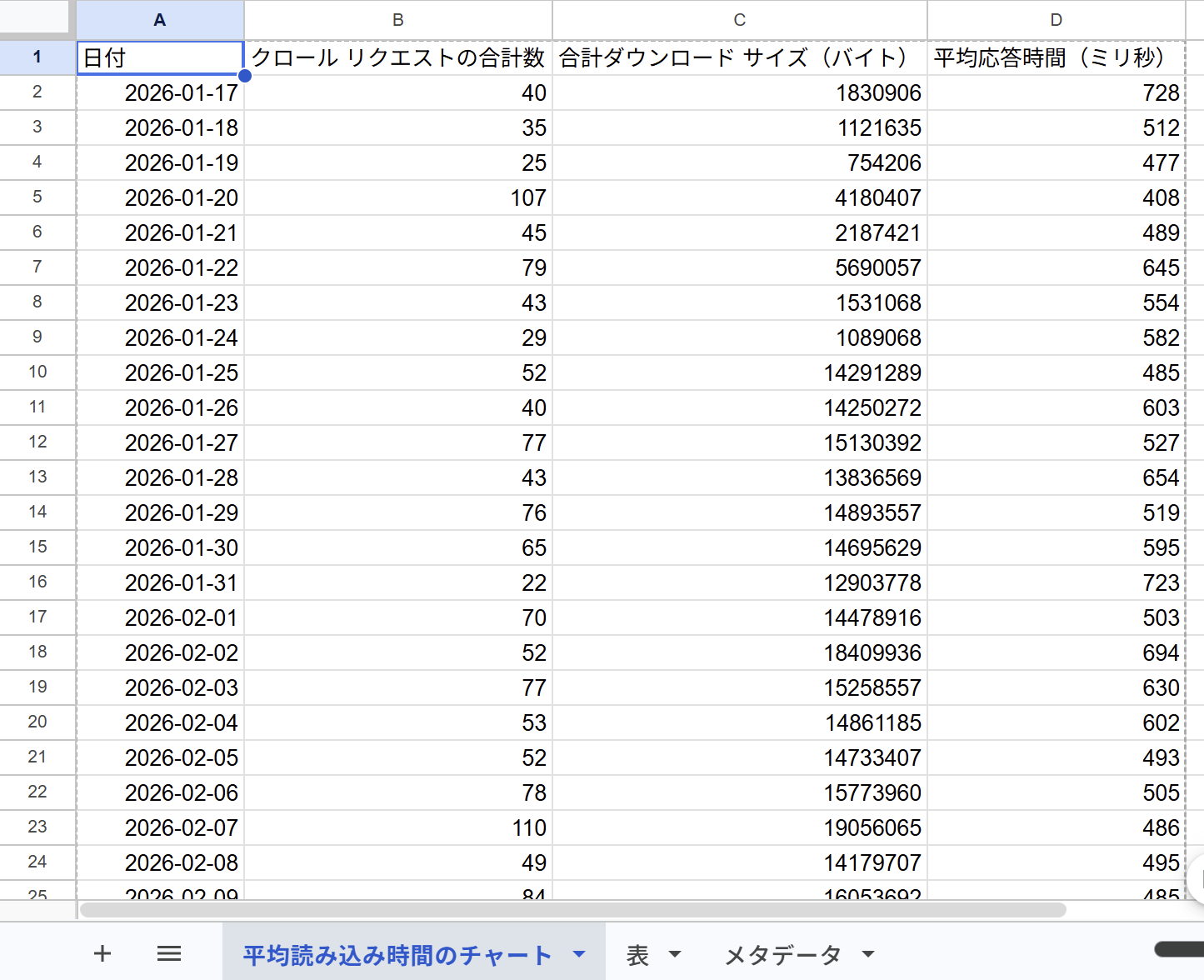

エクスポートしたスプレッドシートには3種類のシートが含まれます。

- チャート(時系列データ)

日別のクロールリクエスト数・ダウンロードサイズ・平均応答時間。長期トレンドを独自に分析するのに使う - 表(個別URL一覧)

クロールイベントごとの時刻・URL・レスポンスコード。実際のクロール挙動を詳細に追える - メタデータ

エクスポート時のフィルタ条件(絞り込んだステータスコードやカテゴリ)を記録

絞り込んだ状態でエクスポートすると、その条件でのURL一覧だけが書き出されます。404URLの一覧を丸ごと取得して、301リダイレクト設定のタスクリストにする、などの使い方が効果的です。

クロールの統計情報から異常を診断する方法

上部のグラフで異常を見つけたら、症状別に原因を絞り込むのが効率的です。典型的な4パターンと対処法を整理しました。

クロール数が急減した

クロール数が急減した場合、Googlebotが「サイトにアクセスできなくなった」または「クロールする必要がない」と判断している可能性があります。

- robots.txtの誤設定

Disallow設定の変更を確認。最近の編集履歴をチェック - サーバー障害

レスポンスレポートで5xxエラーの発生状況を確認 - noindexの大量設置

テンプレート変更などでnoindexが広範囲に付いていないか - サイトマップの問題

サイトマップ送信ステータスを確認し、必要なら再送信

robots.txtの書き方については以下の記事で詳しく解説しています。

関連記事 robots.txtとは?書き方・設定方法とSEOでの注意点 →クロール数が急増した

クロール数の急増自体は悪いことではありませんが、不要なURLのクロールが増えている場合はクロールバジェットの浪費につながります。

- 大量の新規ページ追加

意図した増加なら問題なし - URLパラメータの爆発

ファセット検索や並び替えURLなど、重複コンテンツを生むURLが発生していないか - 不要なファセットURL生成

canonicalタグやrobots.txtで整理する

クロールバジェットの最適化については以下の記事が参考になります。

関連記事 クロールバジェットとは?SEOでの重要性と最適化の方法 →応答時間が悪化した(1秒超)

平均応答時間が1秒を超えて悪化した場合、サイトのパフォーマンス全体に影響するため早期の対処が必要です。

- サーバースペック不足

アクセス増に応じてプラン変更やスケールアップを検討 - 画像最適化不足

WebP化、圧縮、遅延読み込みを実施 - データベースクエリの遅延

インデックス設定や不要クエリの見直し - プラグインの過剰

WordPress等では未使用プラグインを整理

404エラーが多発している

レスポンス別レポートで404が目立つ場合、削除済みページへのリンクが残っているか、サイトマップが古い可能性があります。

- 削除済みページへのリンク残留

内部リンクを修正、または301リダイレクトを設定 - 古いサイトマップ

存在しないURLを含むサイトマップを更新 - 外部からの切れリンク

流入があるURLのみ301リダイレクトを検討

ただし404自体が必ずしもSEOに悪影響を与えるわけではありません。対処が必要なケースと放置してよいケースの判断基準は先ほど紹介した404の記事を参考にしてください。

クロールの統計情報を実務で活かすチェックリスト

クロールの統計情報は「開いたときだけ見る」では異常の早期発見につながりません。月次の定期チェックを習慣化するのがおすすめです。

月次で確認すべき3つのポイント

- 平均応答時間の推移が悪化傾向になっていないか

- レスポンスコード別で404や5xxが増えていないか

- クロール目的のバランス(発見と更新)に異常な変化がないか

この3つを押さえておけば、サイトの技術的な異変を早期にキャッチできます。特に応答時間の悪化はアクセス数増加の前兆であったり、サーバー障害の予兆だったりするため注視しましょう。

他のGSCレポートとの組み合わせ

クロールの統計情報単体では見えない問題も、他のレポートと組み合わせることで浮かび上がります。

- クロール統計 × インデックスカバレッジ

クロールはされているのにインデックスされない問題の原因を特定 - クロール統計 × サイトマップレポート

サイトマップ送信URLが正しくクロールされているか検証 - クロール統計 × 検索パフォーマンス

クロール頻度と検索流入の相関を分析

インデックス状況の全体像は以下の記事でカバレッジレポートの見方を解説しています。

関連記事 インデックスカバレッジ全18ステータス解説 →よくある質問

項目の右側にある「レポートを開く」ボタンをクリックすると詳細画面が表示されます。検索パフォーマンスレポートとは別の場所にあるため、初めて見る方は見逃しやすい位置です。

ドメインプロパティを登録し直すと表示されるようになります。DNS認証での所有権確認が必要なため、ドメイン管理画面にアクセスできる状態で準備してください。

個別URLについてはURL検査ツールでインデックス登録をリクエストできます。ただしリクエストしても必ずインデックスされるわけではないため、コンテンツの質や内部リンクの充実も合わせて確認することが大切です。

良質なコンテンツを継続的に更新する、内部リンク構造を整える、サーバー応答速度を改善する、サイトマップを定期的に更新する、などでGooglebotに「巡回する価値のあるサイト」と認識させると頻度が上がりやすくなります。

サイトリニューアル後、大量のページ追加後、インデックスされないページが増えたとき、サーバー変更直後などは規模に関係なくチェックしましょう。普段は月1回程度の定期確認で十分です。

まとめ

- クロールの統計情報はGSCの「設定」内にあるレポートで、Googlebotの巡回行動を直接確認できる

- 見るべき主要指標は「クロールリクエスト数」「ダウンロードサイズ」「平均応答時間」「ホストステータス」の4つ

- 平均応答時間の目安は100〜500ミリ秒。1秒を超えるとサーバーやページ速度の改善が必要

- クロール数の急減・急増、404多発、応答時間悪化は典型的な異常パターン。症状別に原因と対処を押さえる

- インデックスカバレッジやクロールバジェットと組み合わせて定期モニタリングすると技術的問題を早期発見できる

クロールの統計情報は、サーチコンソールの中でも特にテクニカルSEOの視点が要求されるレポートです。すべての項目を一度に理解しようとせず、まずは上部の3つのグラフとホストステータスから確認する習慣をつけるのがおすすめです。

月次の定期チェックで異常の早期発見につなげ、インデックスカバレッジやクロールバジェットと組み合わせて技術的な健全性を保ちましょう。

サーチコンソール全体の使い方を把握したい場合は以下の記事も参考にしてください。

関連記事 Googleサーチコンソールとは?使い方と見るべきポイントを初心者向けに解説 →\ クロール頻度の変化を、 URLごとに毎日自動取得 /

inSiteのインデックス状況自動チェック機能

inSiteは全ページのインデックス状態を URL Inspection API で毎日自動取得し、 lastCrawlTime と crawledAs (MOBILE/DESKTOP) を蓄積します。GSC本体のクロール統計ではサイト全体しか見えませんが、 inSiteならURLごとにクロール頻度をモニタリングできます。

lastCrawlTime・crawledAs を全URLで毎日蓄積

インデックス状況自動チェック機能の詳細を見る ↗inSiteのインデックス状況自動チェック機能を無料で試してみる